威胁人类:为什么我们需要智慧的人工智能吗?

Source:

Source:

<当Norbert维纳、父亲的控制,他写书"的人使用的人"在1950年,真空管仍然主要的电子构建模块以及,事实上,只有少数几台计算机。 然而,他想到未来,我们现在看到,以前所未有的精度,犯了一个错误只有在微不足道的细节。

<<跨id="更310100">

<之前的任何其他的哲学家的人工智能,他意识到,AI不是简单地模仿的和替代的人类存在多种类型的知识活动,但也改变人们的过程。 "我们只是漩涡在河永远流动的水,"他说。 "我们不是东西,只是住,我们的模式,延续自己。"

<例如,当有一个很大的吸引人的特点,我们愿意付出和接受小商业经营成本以访问的新机会。 和我们很快上瘾新的工具,我们失去的能力,没有他们存在。 选择成为强制性的。

<这是一个很老的故事演变,一个章节,她熟知我们。 大多数哺乳动物中可以合成自己的维生素C,但是灵长类动物、饮食主要是水果,已经失去了这一内置能力。 自我重复的模式,我们呼叫的人,现在取决于服装、食品加工、维生素、注射器、信用卡、智能手机和互联网。 和明天,如果今天不从人工智能。

<维也纳预见到的几个问题,这个情况是,其它的乐观主义者AI很大程度上被忽视。 真正的威胁,他说,:

<…这样的机器,虽然无助,可以使用由该人或阻止的人,以增加他们控制其他种族,或政治领导人可以尝试采取控制的地人,不是机器本身,而政治方法,偷走了作为狭窄和无动于衷的人,如果他们发明的机械。

<显然,这些危险是现在非常相关的。

<在媒体上,例如,创新的数字音频和视频让我们付出小小的代价(在眼睛上的发烧友和电影爱好者)的排斥模拟格式,并在回收非常简单—太简单了—游戏方式记录有几乎没有任何限制。

<但是有一个巨大的隐藏代价。 该部的真相,奥威尔成为一个现实的可能性。 方法AI创建几乎没有区别假的"记录"这样做的过时的工具,我们用于调查过去150年。

<我们就必须放弃短期的照相证据和回复到旧的世界里,一个人的记忆和信任的黄金标准。 或者我们可以开发新方法的防御和攻击的战斗,为的真相。 一个令人兴奋的最近实例是事实,摧毁声誉的便宜很多于同样的声誉来获得和保护。 维也纳看到这个现象很广泛:"在长期之间没有区别武装我们自己和武装敌人"。 信息时代也是时代的错误信息。

<我们可以做些什么呢? 关键是观测的维也纳,"这些车","无助自己。" 我们创建的工具,不同事,并且真正威胁是,我们看不到的差异。

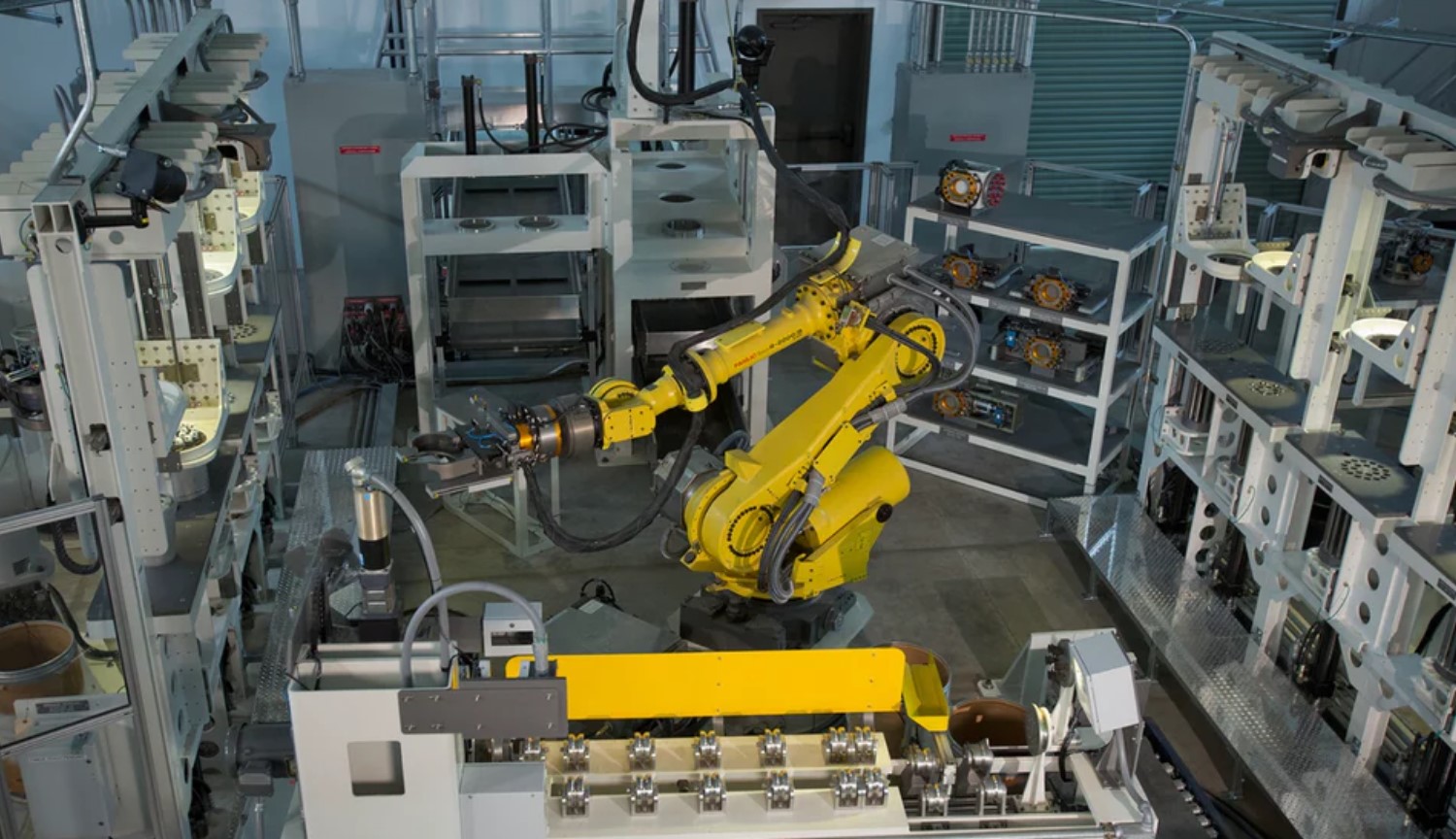

<人工智能在其目前的表现形式,是一种寄生虫在人类的智慧。 他宁毫不客气地占有的所有创建的通过人民的创造者,并删除模式—包括我们最隐秘的生活习惯。 这些机器没有目标或战略都不能自我批评的和创新,它们仅仅是在研究我们的数据库,而不必你自己的想法和目标。

<他们说,维也纳,无奈不是在这个意义上,它们链接,或者克制,不,他们不是药剂—他们有没有机会"行动的原因,"将Kant.

<在长期的"强AI"或一般人工智能在原则上是可能的,但不可取的。 甚至更为有限AI,可能在实践今天,不会邪恶。 但他是一个威胁,部分原因是它可能被误认为是强。

如何强大的人工智能的今天?

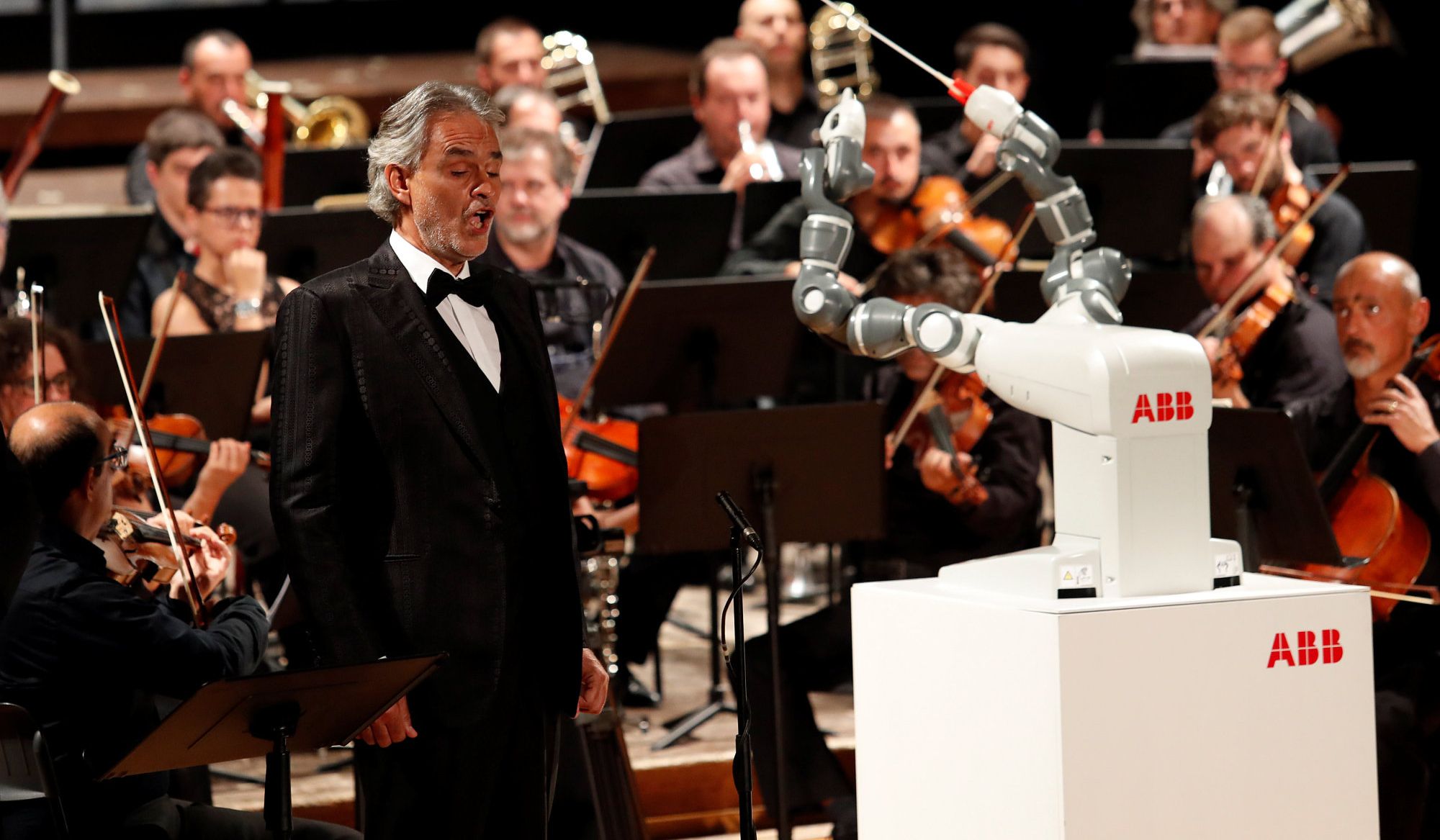

<之间的差距今天的系统和科幻小说的系统,泛滥的流行的想象力,仍然是巨大的,虽然许多人,无论是业余爱好者和专业人员往往低估了它。 让我们来看看华森从IBM,这很可能是值得尊重,在我们的时间。 <这个超级计算机的结果是一个非常广泛的过程的研发(研发),这是涉及许多人的发展和设计的情报对于许多世纪以来,它使用数以千计的时间更多的能量比人类的大脑。 他的胜利在的危险! 是一个真正的胜利,这成为可能,是由于规定限制的规则的危险!, 但是,他可以采取部分,即使这些规则必须修订。 我们不得不放弃普遍性和增加人类作一个展示。 <沃森不良公司,尽管有误导性的广告,从IBM,承诺对话的能力AI上体积的水平,但是转向华生成一个多层面的最可能的代理将是类似于转换计算器,Watson。 Watson可能是一个很好的情况下,用于计算这种代理,而是小脑或杏仁核,但是不介意—最好的,一个子系统的特别部队,在一个支持作用,但几乎没有系统规划和设定目标取决于收到的讲话的经验。 <以及我们为什么要创建一个思维和创造性剂的华生? 也许是一个绝妙的主意图灵的名图灵试验的诱惑我们进入陷阱:我们沉迷于创建至少幻想的一个真正的人坐在前面的屏幕,绕过"不可思议的谷"。 <危险的是,由于图灵提出了他的目标—这是首要任务,以欺骗的法官的创造者艾试图做到这一点有趣的人形中的木偶角色"漫画"的版本,这将吸引和解除武装的外行. 伊丽莎约瑟夫*魏泽鲍姆,第一个提示机器人,是一个光辉的榜样建立这样一种幻想,这是非常简单的算法,可能诱使人们,他们是真诚和衷心的对话与其他人。 <它感到不安的是通过方便人们愿意相信它。 如果我们学到了什么从一年一度的竞争对传递一个有限图灵试验,洛伯纳奖的事实是,即使是最聪明的人是不能在计算机编程,是非常易于这些简单的技巧。 <态度的人民在该领域AI以这样的方法从不同谴责鼓励和协商一致的是,所有这些技巧是不是特别深刻的,但可能是有用的。 改变态度,这将是非常有用的,是真诚的承认画娃娃机器人是虚假广告,这应该受到谴责,不受到鼓励。 <如何实现这一目标? 一旦我们了解,人们开始作出决定的生活和死亡,下列的"意见"的人工智能系统,内部操作这实际上是不可想象的,我们将看到一个很好的理由那些人打电话的人要相信这样的系统,开始依赖于规则的道德和法律。 <人工智能系统是非常强大的工具。 如此强大,即使专家们有一个很好的理由不相信自己的判断时有"判决"的提供这些工具。 但是,如果这些用户的工具都会受益,金融或其他从普及推广这些工具,它们必须确信,你知道如何做到这一点与所有金额的责任,最大程度的控制和理由。 <许可和批准的行动运营商的此类系统—正如我们许可证的药剂师,经营者的起重机和其他专业人员、错误和误解可能有严重的后果—也许与支持的保险公司和其他组织,迫使创作者的人工智能系统要走很长的路,寻找弱点和缺陷,他们的产品和教育的那些人是要与他们合作。 <你可以想象一种反向图灵试验的评估将是法官,直到他发现一个弱点,违反了界限,存在的差距系统,许可证收到的。 获得证书这样的法官将需要认真培训。 希望赋予的对象的人的能力以认为,作为我们通常做的,会议有一个合理的代理,是非常、非常强。 <事实上,抵抗的能力的渴望看到的东西的一个拟人化的人—一个奇怪的事情。 许多人会发现培养这种人才是有问题的,因为即使是最实用的系统用户的周期性地提到他们的文书"友好"。 <无论多么精心的设计师的人工智能将消除虚假的"人"触摸他们的产品,我们应该期望的鼎盛时期的快捷方式,解决方法,并允许扭曲了实际的"了解"如何系统和其运营商。 就像在电视上广告的药物的一个长长的清单的副作用或酒精,提供影片与大量的小型打印的所有法律规定的,警告和开发人员的人工智能将遵守法律,但在的警告。为什么我们需要人工智能吗?

<我们不需要人为二氧剂。 有很多的自然发现的药剂,这足以执行任何任务旨在为专家和有特权的少数。 我们需要明智的工具。 工具没有任何权利,不应有感情,可伤害或者它可以是"滥用". <的原因之一不做的人为二氧剂的是,尽管他们可自治(和在原则上他们可以作为自主的,Smoluchowski或samostoiatelnyi为的任何人),他们应该没有—没有特别权限分享我们自然意识到代理我们的脆弱性和我们的死亡率。 <丹尼尔*丹尼特,以哲学系教授从塔夫茨大学,一旦把以前的学生任务的讲习班的人工剂和自主权给我规范的机器人,将能够签订合同,不是一个替代的,它拥有的另一人,本身。 这不是一个问题的理解的原因或操纵的笔和纸,而是所有权和占有光荣的法律地位和道德责任。 小孩子不能签订合同,例如残疾人的法律地位,这迫使他们能照顾下,并规定有责任的受托人。 <问题的机器人,可能想要获得这样一个崇高的地位,像超人一样,他们都太容易受到做出这样的声明。 如果他们拒绝的话,会发生什么事? 是什么惩罚违反承诺? 他们将被锁在笼子里或者分开? 监狱里的人工智能不会带来的不便,如果我们只能下载渴望自由,不能被忽视或禁止通过大赦国际的。 拆卸AI不会杀的信息,储存在磁盘和软件。 <易数字录音和数据传送的—的一个突破,允许软件和数据,本质上的不朽,使机器人不可战胜的。 如果它不似乎显而易见的,想想你将如何改变道德观的人,如果我们可以做"的备份"的人每星期。 跳下桥的没有糖星期日后的星期五备份可能是一个轻率的决定,你可以记录然后观看他的过早死亡在稍后的日期。 <这就是为什么我们不是创建一个有意识—我想创建类人的代理,而是一个完全新型的生物,一些预言,而没有意识,没有对死亡的恐惧,而不分神的爱与恨,没有个性:反射镜的真相,他将几乎肯定会被感染的人的谎言。 <人使用的人为改变—再一次—永远,但如果我们承担责任,我们的进化论的轨迹,我们就可以避免不必要的危险。 <你不同意吗? 告诉我们关于你的意见建议

Dyslexia affects about 10% of the world's population There are many diseases in the world that are associated with disorders of the brain and spinal cord, as well as various groups of nerves. These diseases are called neurological disorders and one o...

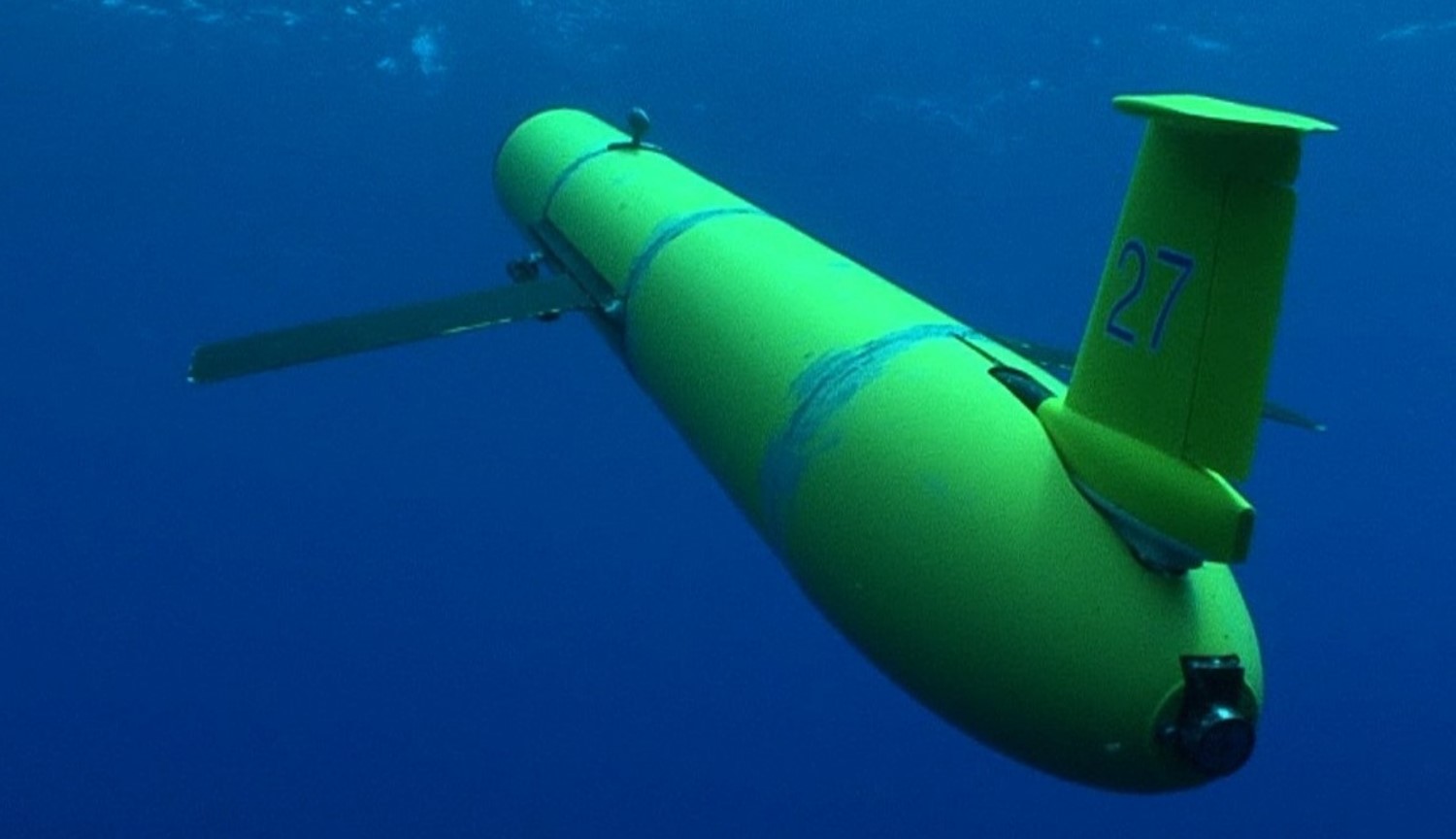

这种设计是不可能飞的速度几千公里每小时。 这需要其它的特征。 的现代飞机可以飞行速度非常快。 在«;快速»;我明白这不是速度快10倍的速度比的汽车,真的很快。 即使没有加力模式下,现代战斗机很容易克服的声音的速度。 一乘客的飞机已经飞行以超音速度。 它是可能的,但是昂贵的,所以(包括)的航班,并停止大约20年前。 一切都是好的,但是如果你深入的历史记录和档案文件,可以发现几架飞机,飞行不仅仅是超音速和高超音速,也就是几倍音速。 怎么可能发生什么事了他们和他们是否存在吗? 在结束时...

在互联网上出现的第一次审查在提供商粟米 美国企业家,伊隆*马斯(伊隆麝香)不仅涉及与制造的电动汽车和飞船。 在2015年,他创建公司粟米,其目的是确保互联网上的居民甚至最遥远的角落,我们的星球。 有成千上万的空间卫星互联网分布的村庄的居民将能够走向社会网络,并成为世界各地的用户。 在第一半,2020年,金额的粟米卫星在地球轨道超过500件,因此该公司决定启动该系统在测试模式。 互联网从伊隆*马斯可以从中受益的一些居民的美国和加拿大。 他们测量速度的上载和下载文件,并共享信息有关的延迟(平). 概...

相关消息

...

...

...

评论意见 (0)

这篇文章已经没有意见,是第一个!